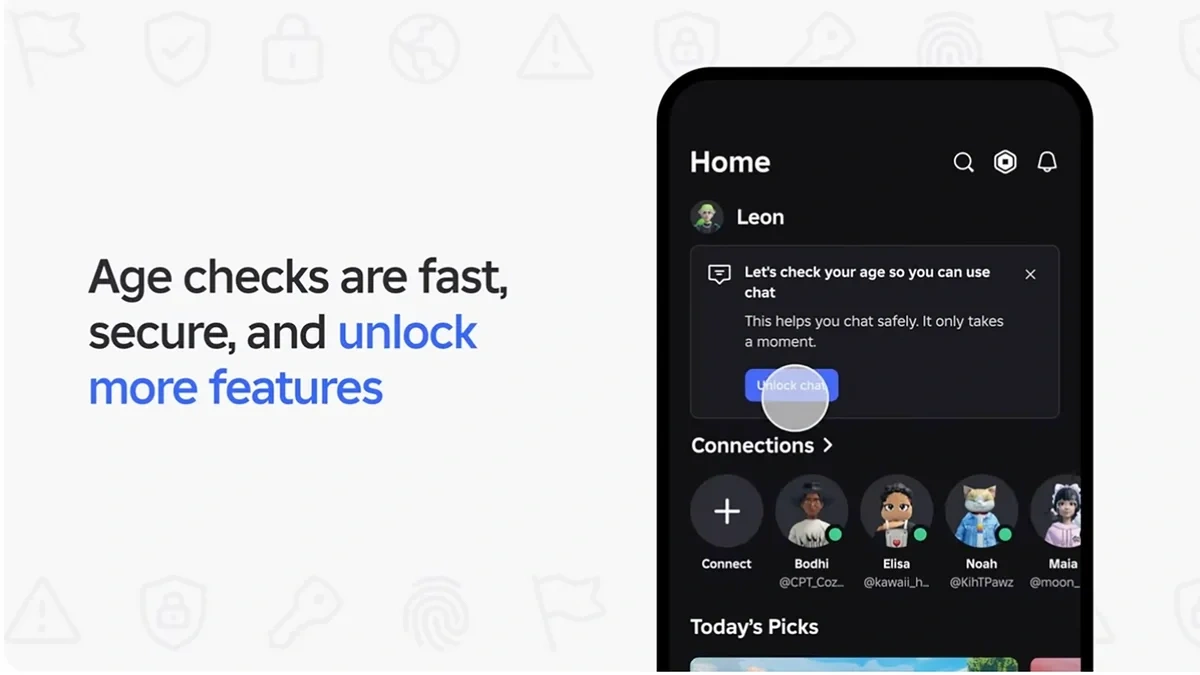

Die Plattform Roblox hat weltweit mit dem Rollout eines neuen KI gestützten Systems zur Altersverifikation begonnen. Ziel der Maßnahme ist es, den In Game Chat sicherer zu machen, insbesondere für jüngere Spieler. Doch nur wenige Wochen nach dem Start zeigt sich, dass das System eher für Frust, Umgehungsversuche und neue Datenschutzdebatten sorgt.

Wie funktioniert die neue Altersprüfung?

Spieler, die den Chat nutzen möchten, müssen ihr Alter bestätigen. Dazu setzt Roblox auf eine KI, die anhand eines Gesichtsscans das ungefähre Alter schätzt. Alternativ können Nutzer ab 13 Jahren ihr Alter auch über ein Ausweisdokument verifizieren.

Die Altersangabe entscheidet darüber, mit welchen anderen Nutzern kommuniziert werden darf. Ein 13 jähriger Spieler kann beispielsweise nur mit Personen in einem begrenzten Altersbereich chatten, während ältere Nutzer entsprechend andere Gruppen freigeschaltet bekommen. Roblox will damit verhindern, dass Minderjährige unkontrolliert mit deutlich älteren Spielern interagieren.

Falsche Einstufungen und einfache Umgehungen

In der Praxis zeigt sich jedoch, dass das System nur eingeschränkt zuverlässig arbeitet. In sozialen Netzwerken häufen sich Berichte über massive Fehleinschätzungen. Volljährige Nutzer werden teilweise als 13 bis 15 jährig eingestuft, während Kinder angeblich als Erwachsene durchgehen. Auch Eltern, die den Scan für ihre Kinder durchführen, sorgen unbeabsichtigt für falsche Alterszuordnungen.

Besonders problematisch ist, wie leicht sich die Altersprüfung umgehen lässt. Recherchen von Wired zeigen, dass bereits verifizierte Roblox-Accounts auf Online-Marktplätzen verkauft werden, darunter auch Konten mit sehr niedrigen Altersfreigaben. Zusätzlich kursieren Videos, in denen Nutzer die KI mit Avataren, Prominentenfotos oder künstlichen Bärten und Falten täuschen.

Solche Schwächen sind nicht neu. Bereits bei früheren Alterschecks auf Plattformen wie Discord oder Reddit konnten Nutzer KI-Systeme mit einfachen Mitteln austricksen.

Datenschutzbedenken verschärfen die Kritik

Neben den technischen Problemen wächst auch der Widerstand aus Datenschutzgründen. Einige Spieler verweigern die Altersverifikation vollständig und verzichten bewusst auf Chat-Funktionen.

Besonders kritisch wird gesehen, dass die für die Altersprüfung eingesetzte Software vom Unternehmen Persona stammt, das aktuell wegen Datenschutz und Datensicherheitsfragen verklagt wird. Mehrere Content Creator und Sicherheitsexperten warnen daher offen vor der Nutzung des Systems.

Akzeptanz bleibt begrenzt

Nach Angaben von Roblox haben in den ersten Testregionen etwas mehr als 50 Prozent der täglich aktiven Nutzer die Altersverifikation abgeschlossen. Umgekehrt bedeutet das, dass ein großer Teil der Community seit Wochen ohne Chat-Funktionen spielt. Das gilt als deutliches Zeichen für eine begrenzte Akzeptanz.

Ob das neue System langfristig tatsächlich zu mehr Sicherheit auf der Plattform führt oder vor allem neue Probleme schafft, ist derzeit offen. Klar ist jedoch, dass die Einführung der KI gestützten Altersprüfung das Vertrauen vieler Nutzer nicht gestärkt hat.

FAQ

Roblox hat eine KI-gestützte Altersprüfung eingeführt, bei der das Alter eines Nutzers anhand eines Selfies geschätzt wird. Ohne erfolgreiche Verifikation ist der Zugang zu Chat-Funktionen eingeschränkt.

Roblox will damit den Kinderschutz verbessern und verhindern, dass Minderjährige mit deutlich älteren Nutzern chatten. Der Schritt folgt auf politischen und medialen Druck wegen Sicherheitsbedenken.

Die Altersverifikation ist verpflichtend, wenn Spieler Chat-Funktionen nutzen möchten. Wer sie ablehnt, kann zwar weiterhin spielen, aber nicht kommunizieren.

Die KI analysiert Gesichtszüge und schätzt daraus das ungefähre Alter. Die Einordnung erfolgt in Altersgruppen, nicht als exaktes Geburtsdatum.

Viele Nutzer berichten von massiven Fehleinschätzungen. Erwachsene werden teils als Jugendliche eingestuft, während Kinder in deutlich höhere Altersgruppen rutschen. Ursachen sind unklare Trainingsdaten und begrenzte KI-Genauigkeit.

Ja. Nutzer zeigen online zahlreiche Umgehungsmethoden, etwa mit Fotos, Avataren, KI-Bildern oder Verkleidungen. Auch Eltern, die für ihre Kinder verifizieren, verfälschen das System.

Ja. Viele Spieler verweigern die Verifikation aus Sorge um ihre biometrischen Daten. Zusätzlich steht der Dienstleister Persona wegen Datenschutzfragen in der Kritik.

Das ist bislang unklar. Trotz Einführung nutzen viele Spieler weiterhin keine Chat-Funktionen oder umgehen das System. Ob die Maßnahme langfristig mehr Schutz bietet, bleibt offen.